Dans le domaine du son aussi, la numérisation de l’information a été à l’origine de bouleversements considérables.

Dans le domaine du son aussi, la numérisation de l’information a été à l’origine de bouleversements considérables.

Pour les comprendre un bref historique des modes de production des sons organisés par les instruments de musique est nécessaire.

L’instrument mécanique ou « acoustique »

De la même manière que l’outil a été une extension des possibilités offertes directement par le corps humain, l’instrument de musique vient compléter et étendre les procédés d’organisation de sons par la voix.

Cette étape, la plus ancienne dans la facture instrumentale, se caractérise par la recherche de procédés qui utilisent les vibrations physiques de corps solides. Des dizaines de générations d’artisans chercheront d’une manière empirique les moyens d’améliorer la qualité et la puissance de leurs instruments, sans augmenter si possible leur encombrement.

Tous les instruments mécaniques se composent de quatre éléments :

– Un élément matériel pouvant vibrer dans les fréquences audibles par l’oreille humaine

– Un système quelconque qui permet au musicien de le mettre en vibration

– Un matériau lié d’une manière mécanique au « vibreur », qui reçoit la vibration et en la diffusant, l’amplifie

– En général, un résonateur à qui sont transmises, par l’air ou par un lien mécanique, ces vibrations amplifiées.

Tableau des composants de l’instrument acoustique.

|

Instrument |

Élément vibrant |

Système de mise en vibration |

Amplificateur et résonateur |

Liaison mécanique entre vibreur et amplificateur |

| Violon | Cordes | Archet | Table d’harmonie et caisse du violon | Chevalet et âme |

| Piano | Cordes | Percussion par un marteau | Table d’harmonie | Chevalet |

| Guitare | Cordes | Doigt du musicien | Table d’harmonie et caisse de la guitare | Chevalet |

| Clarinette | Anche | Souffle du musicien | Le corps

de l’instrument |

Ligature de l’anche |

| Trompette | Lèvres du musicien | Souffle du musicien | Corps de l’instrument | Pression des lèvres sur l’embouchure |

| Vibraphone | Plaques de métal | Percussion par une baguette | La plaque elle-même et les résonateurs | La plaque est à la fois l’élément vibrant et l’amplificateur |

| Timbale | Peau tendue | Percussion par une mailloche | Fût de métal sur lequel est tendue la peau | Pression de la peau sur le fût par le cerclage |

L’instrument électromécanique

Cette étape a eu pour conséquence de supprimer les éléments physiques qui servaient d’amplificateur et de résonateur en leur substituant un haut-parleur. Dans ce type de systèmes un capteur électromagnétique (microphone) transforme les oscillations périodiques du vibreur matériel en un courant électrique, traité ensuite par divers appareils pour aboutir à un haut-parleur. Ce dernier, excité par ce courant modifié et amplifié, produira par des déplacements de sa membrane les vibrations de l’air qui à leur tour se traduiront par des différences de pression sur le tympan humain.

Ces inventions sont à l’origine de la plupart des instruments apparus dans les années 60 caractéristiques de la musique populaire : la guitare électrique, l’orgue Hammond à roues phoniques, le piano Fender. On assiste alors à une augmentation considérable des puissances acoustiques délivrées grâce aux systèmes de sonorisation : de très petites formations de trois, quatre ou cinq musiciens peuvent facilement se faire entendre dans des salles de plus en plus grandes.[1]

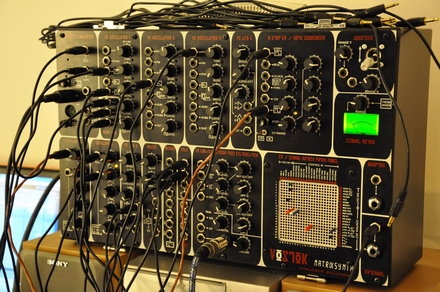

L’instrument électro-analogique

Cette étape a pour effet de créer des instruments qui éliminent le vibreur physique et le remplacent par des générateurs oscillants (oscillateurs), qui produisent directement le courant électrique. Ces signaux électriques seront combinés, modulés entre eux, traités par divers appareils pour s’efforcer de se rapprocher de la richesse et de la complexité des sons produits par les instruments mécaniques et électromécaniques.

Lorsque l’on arrive à décomposer un son et à comprendre ses constituants tels que la forme de l’onde (carrée, sinus, triangle etc), sa hauteur (fréquence), son mode d’apparition et de disparition (enveloppe), la tentation évidente a été de créer des appareils qui, reproduisant ces paramètres, permettent à l’utilisateur de les modifier à sa convenance : les premiers synthétiseurs sonores dits « analogiques » sont nés.

L’apport des technologies de l’information.

Les technologies de l’information vont d’abord intervenir pour permettre de reproduire les réglages du synthétiseur d’une manière précise et automatique :

* Réglages des hauteurs de notes

* Réglages de sonorités ensuite, car au fur et à mesure que les synthétiseurs se perfectionnaient en boutons et tirettes de toute sorte, leur gestion « en direct » au cours de l’exécution d’un morceau devenait de plus en plus hasardeuse. Il fallait, comme pour les éclairages, pouvoir mémoriser et stocker des réglages afin de les appeler instantanément et sans erreur. Chaque ensemble de réglages devenait un « son » du synthétiseur, et chaque musicien pouvait fabriquer les siens, copier ceux d’un collègue équipé du même appareil, ou charger des « sons » à partir d’une banque quelconque, proposée par exemple par le constructeur.

Comme tous les fabricants étaient confrontés aux mêmes nécessités, ils eurent l’intelligence de s’entendre sur une norme qui permettait aux appareils de marques et de modèles différents de communiquer entre eux. Ceci aboutit à la définition du MIDI (Musical Instrument Digital Interface) qui comportait pour tous les appareils une partie commune et une partie propre à chaque modèle d’instrument.

Ainsi, à titre d’exemple, il devenait possible de connecter par les prises MIDI un synthétiseur Yamaha et un Roland et de déclencher le second à partir du clavier du premier. En effet, grâce à cette norme, le Roland recevait, par la pression, puis le relâchement d’une touche, un ensemble de commandes émises par le clavier du Yamaha, codées d’une manière identique, et qui étaient donc interprétées de la même manière par les deux appareils :

* L’information « hauteur de la note » : en jouant un « do » sur le premier, on déclenchait la même note sur le deuxième.

* Les informations « émettre la note » (note on), puis « cesser l’émission » (note off), ce qui permettait aux deux appareils de « jouer en même temps ».

* Informations de dynamique dans l’exécution des notes, changements de sonorités etc….)

Rapidement, les synthétiseurs se chargèrent ainsi en possibilités de communication entre eux, mais très logiquement, puisque les messages utilisés et transmis étaient des codes numériques, on a pu développer leur traitement grâce à des logiciels informatiques.

Avec les logiciels d’aide à la création de sonorités sur les synthétiseurs complexes, apparaissent également les séquencers. Ces logiciels permettent la mémorisation ou l’écriture directe de séquences de notes, c’est à dire d’œuvres musicales, que l’on pouvait alors corriger, manipuler, par exemple copier-coller comme n’importe quel texte sur Word.

Un seul individu travaillant avec un ordinateur, quelques synthétiseurs, boîtes à rythmes et appareils d’effets cumule les fonctions de compositeur, arrangeur, interprète et ingénieur du son. La qualité artistique de son travail cesse d’être tributaire de cet ensemble d’intervenants extérieurs, et ne dépend plus alors que de son talent personnel et des machines dont il dispose. En outre, il peut facilement produire des « maquettes » avant l’enregistrement définitif dans un studio professionnel dont la justification se limitera de plus en plus à posséder certains appareils très performants et très coûteux, et à procéder aux enregistrements des voix et « vrais » instruments que l’on pourrait décider d’utiliser par choix esthétique.

Le temps d’enregistrement en studio, surtout si on n’utilise que des synthétiseurs, se réduit considérablement, car, en réalité, le travail aura déjà été préparé sur un ordinateur dans un home studio. Il suffira d’introduire le fichier transmis directement par un réseau ou sur un support (de la disquette à la clé USB) qui contient toute les données de la composition dans l’ordinateur du studio, d’affiner ou de choisir éventuellement les sonorités sur les synthétiseurs et les effets mis à la disposition du client, et enfin de mélanger (mixer) les pistes pour en faire un master destiné à être dupliqué. Cette opération elle-même d’ailleurs, deviendra de plus en plus automatisée.

Après la synthèse sonore, la phase suivante a été l’introduction de l’échantillonneur[2].

Il ne s’agit plus cette fois d’un appareil qui crée ou imite un son en le recomposant à partir de ses formants élémentaires, mais qui enregistre un son existant tel quel, et qui peut l’affecter à un clavier ou un séquencer qui pourra le déclencher à la demande, et ainsi le « jouer » sans intervention de la source qui l’a émis au départ. On demandera, par exemple à un violoncelliste prestigieux qui a consacré trente ans de sa vie à travailler sa sonorité de jouer sur son instrument les douze demi-tons de la gamme chromatique sur plusieurs octaves, puis on le remerciera poliment. La machine aura mémorisé ses « échantillons », et un séquencer ou un clavier pourra interpréter n’importe quelle mélodie avec sa sonorité de violoncelle. La capture de ces « échantillons » peut s’effectuer à partir de n’importe quelle source sonore, y compris un disque ou une bande magnétique.

Au fur et à mesure que les quantités d’informations numériques (et donc la taille et la durée des échantillons) augmentaient grâce aux progrès des capacités de mémoire des machines, l’échantillonnage devient un véritable outil d’enregistrement numérique avec comme support de stockage de l’information un disque dur d’ordinateur, et donc un accès direct et des possibilités de manipulation par des logiciels.

Les possibilités de manipulations deviennent alors infinies. On peut, pour les besoins d’un film reconstituer la voix d’un castrat : il suffit, pour cela d’échantillonner une voix féminine de contralto et une voix de haute contre masculine, puis travailler sur leur mélange et leur homogénéisation. Le numérique permet même de générer des notes impossibles à chanter.

On peut faire un pot-pourri en continu de quelques couplets de vieux tubes des années 60, alors qu’ils n’ont pas été enregistrés dans la même tonalité ni le même tempo : il suffit de les échantillonner. A l’aide d’un logiciel approprié on peut faire toutes les manipulations que l’on souhaite, sans dénaturer les timbres des voix et des instruments.

Il est même possible d’enregistrer avec un artiste mort à condition de disposer d’un échantillon significatif de sa voix sous forme d’enregistrement. Il n’est plus utile de savoir chanter juste, on peut corriger les fausses notes directement sur l’échantillon, et certains appareils le font même en direct ! A partir du moment où un son quelconque est converti en un fichier numérique, tout ou presque, devient possible.

Les séquencers MIDI ne nécessitaient pas, sauf pour des œuvres vraiment très volumineuses, des capacités de mémoire importantes car les ordinateurs ne stockaient pas des sons mais des codes de commandes destinés à actionner des synthétiseurs qui eux, produisaient les sons. L’enregistrement numérique, réclamant, en revanche, des capacités de stockage beaucoup plus conséquentes, a du, d’abord, fait un détour par des supports qui n’autorisaient pas leur traitement informatique direct (bandes magnétiques ou bandes vidéo).

Avec l’augmentation des puissances de calcul et de stockage des ordinateurs nous entrons dans l’ère des « direct to disk » qui constituent une alternative aux machines d’enregistrement numérique antérieures avec trois avantages essentiels : leur coût en équipement plus faible, leur fiabilité accrue[3] en raison de l’absence de « mécanique », leur extraordinaire souplesse d’utilisation, et surtout la possibilité de réunir dans une seule machine tous les appareils antérieurs de traitement du son et de l’image ! Autrement dit, un seul ordinateur équipé de quelques logiciels sera l’équivalent d’une régie de montage vidéo et d’un studio d’enregistrement.

La modélisation instrumentale.

Cette étape, très excitante, est en cours de gestation. Son principe est de créer une information sonore à partir des paramètres physiques mis en jeu dans l’émission d’un son. A partir de l’échantillon d’un son, ces logiciels déterminent qu’il a été produit par tel élément vibrant, à telle fréquence, qu’il a telle composition en harmoniques diverses, telle décomposition au niveau de son attaque etc…Mais il indique ensuite par quels procédés vibratoires physiques il a été obtenu (une corde de telle longueur, en tel matériau, mise en mouvement par tel procédé, une table d’harmonie de telle taille, de telle forme, en tel matériau etc…) Il est possible de faire varier ces paramètres et d’entendre le résultat. Ainsi, on peut imaginer une flûte traversière où le tube serait allongé trois fois de sa longueur et recourbé sur lui-même en forme de colimaçon. Il n’est plus nécessaire de construire matériellement un tel instrument, le logiciel intègre ces paramètres, modélise l’instrument, et fait entendre le son qu’il produirait. S’il vous satisfait, rien ne vous interdit d’en donner les cotes et les plans à un artisan pour qu’il le construise. Il s’agit bien, cette fois, d’instruments virtuels, et non de simple synthèse sonore ou de manipulation grossière d’échantillons.

MAJ du 3 novembre 2014 :

Lorsque j’ai écrit la première mouture de cet article, dans les années 90, la modélisation instrumentale relevait quasiment de la science-fiction. Depuis, les progrès ont été fulgurants, ses applications sont désormais courantes. Quelques exemples : la firme Line 6 produit des micros qui émulent (c’st à dire qui reproduisent par modélisation), la plupart des micros dynamiques standards. Sur l’un de leurs modèles vous pouvez ainsi choisir d’avoir les son de tel micro Shure ou AKG ou autre. Pour personnellement utiliser celui qui émule le SM 58 Shure sans fil, pour un prix bien inférieur au modèle original, le résultat est stupéfiant avec en plus, une linéarité quasi-parfaite, l’absence de compression-expansion, contrairement à ce qui se passe avec les micros dynamiques. La même firme qui s’est spécialisée dans la modélisation vous propose des boîtiers qui reproduisent le son des principaux modèles de guitare électrique, les plus prestigieux, dont vous pouvez obtenir le son quel que soit votre instrument réel, le plus pourri soit-il. Elle propose également des petits amplis qui modélisent les appareils les plus connus. Vous pouvez ainsi avoir le son d’un Marshall trois corps sur un ampli minuscule, volume en moins. On voit immédiatement la commodité pour les enregistrements, mais surtout le gigantesque bénéfice pour la sonorisation en salle. Enfin, grâce à ces appareils et aux retours sous forme d’oreillettes, il n’y a pratiquement plus de volume sur scène, ce qui permet ( enfin !) de faire une balance correcte en façade avec un confort d’écoute incomparable pour le spectateur.

La modélisation a eu aussi des conséquences formidables pour certains instruments, je reprendrai ici le cas de l’accordéon Roland. La dernière génération, celle des FR X est stupéfiante. Voilà désormais un accordéon dans lequel il n’y a plus de mécanique, le soufflet que vous manipulez n’a plus pour fonction d’insuffler de l’air dans des anches qui n’existent plus, mais seulement d’actionner un moteur qui transmet des informations numériques destinées à l’émission du son. Notre accordéoniste, quand elle essayé cet appareil pour la première fois , s’est dite bluffée par la précision des nuances : c’est comme avec les meilleurs des accordéons du marché. Avec quelques différences notables : celui qu’elle a essayé est un 72 basses, dont le poids moyen pour un accordéon classique est de l’ordre de 8 kg, celui-ci en pèse 6,5 ; son prix est de 1400 euros, contre 8 à 9000 euros pour les bons instruments acoustiques et encore, convient-il d’indiquer que, proposant 16 sons d’accordéon, du bon vieux musette au bandonéon, en passant par le bayan russe, pour faire une comparaison correcte il faudrait additionner les prix d’au moins quatre accordéons différents. Et je ne vous parle pas du reste, la possibilité de jouer au casque, l’interface MIDI qui permet de déclencher n’importe quel synthétiseur, d’accéder à des banques de sons etc. Le plus époustouflant reste les options d’affectation des boutons aussi bien à la main droite (pour les accordéons dits « bouton ») et à la main gauche pour les basses et les accords, ce qui permet d’avoir un seul accordéon pour toutes le musiques et pour tous les modèles de disposition des claviers. (La disposition des notes sur les claviers « boutons » n’est pas la même suivant les traditions des différents pays). Voir la vidéo suivante.

Les quatre schémas ci-dessous qui retracent l’histoire de l’instrument de musique constituent une illustration quasi-parfaite des différentes étapes de la conquête par l’homme de l’énergie, puis de l’information.

* L’instrument acoustique utilise l’énergie mécanique produite par l’homme, véhiculée et transformée par d’autres systèmes mécaniques. L’information y est découverte d’une manière empirique.

* L’instrument électromécanique s’appuie sur la maîtrise de l’électricité et sur la découverte d’un convertisseur d’énergie mécanique en énergie électrique (le microphone).

* L’instrument électro-analogique devient possible lorsque l’on acquiert un savoir scientifique suffisant sur la nature et la composition des ondes sonores produites par les instruments de musique.

* La possibilité de convertir toute information sonore en un fichier numérique permet son traitement par l’ordinateur, jusqu’à l’étape actuelle de la modélisation instrumentale.

Schémas de l’évolution des techniques de production des sons organisés. |

Ces schémas mettent en lumière que le maillon faible de la chaîne est le haut-parleur.

L’oreille humaine, en réalité, fonctionne comme un microphone : les vibrations de l’air mettent en mouvement le tympan qui par un système sophistiqué convertit ces différences de pression en un courant électrique qui parcourt le nerf auditif jusqu’au cerveau. Pour exciter le tympan, on est donc obligé de convertir en bout de chaîne l’énergie utilisée par l’instrument de musique en énergie mécanique. Et on n’a pas trouvé pour le moment de procédé autre que celui du haut-parleur, système lourd et qui malgré les perfectionnements dont il a fait l’objet[4] occasionne des fuites, des déperditions importantes d’énergie et d’informations. A l’inverse des autres sens, pour l’ouïe, l’interface avec l’organisme humain est exclusivement mécanique.

mouvement le tympan qui par un système sophistiqué convertit ces différences de pression en un courant électrique qui parcourt le nerf auditif jusqu’au cerveau. Pour exciter le tympan, on est donc obligé de convertir en bout de chaîne l’énergie utilisée par l’instrument de musique en énergie mécanique. Et on n’a pas trouvé pour le moment de procédé autre que celui du haut-parleur, système lourd et qui malgré les perfectionnements dont il a fait l’objet[4] occasionne des fuites, des déperditions importantes d’énergie et d’informations. A l’inverse des autres sens, pour l’ouïe, l’interface avec l’organisme humain est exclusivement mécanique.

[1] Un orchestre symphonique dans les fortissimo délivre une puissance acoustique d’environ 120.décibels. N’importe quelle sonorisation d’un groupe de rock peut atteindre beaucoup plus.

[2] Pour être complet, il faut signaler une phase intermédiaire entre la synthèse analogique et l’échantillonnage. Ce dernier est très gourmand en mémoire. Or on a pu observer que l’oreille humaine reconnaît un son essentiellement à son attaque. Aussi a-t-on vu apparaître des instruments qui produisaient des sons comportant une attaque échantillonnée à partir d’un instrument acoustique, mais où le reste du son, celui qui s’entend après l’attaque, était totalement synthétique. Cette combinaison capable de duper l’oreille humaine, économise beaucoup de mémoire.

[3] La « fiabilité » reste toutefois relative, l’informatique étant, comme chacun le sait, sujette à des coquetteries tout à fait imprévisibles.

Le « direct to disk » a, en revanche, pour lui, la souplesse d’utilisation, en particulier la fantastique fonction « undo », qui permet le retour en arrière par rapport aux modifications successives qui sont intervenues dans le fichier numérique.

[4] Signalons en particulier le principe de « l’asservissement ». Il s’agit de l’optimisation des vibrations de la membrane d’un haut-parleur par un microprocesseur. Celui-ci analyse les variations du signal électrique qu’il reçoit et corrige, en temps réel, les erreurs de déplacements de la membrane dues à l’inertie du système mécanique utilisé.

Lectures :8791

Ces schémas mettent en lumière que le maillon faible de la chaîne est le haut-parleur.

clairement et c’est bien pour cela que l’imitation numérique est vouée à l’échec, ou du moins, que la réalité de l’instrument (acoustique) sera toujours supérieure, le ressenti aussi. 🙂

mais comment peut-on confondre un véritable accordéon avec un truc qui fait comme si il était un accordéon? 😀

Sans vouloir jouer au super Omniscient technolo ____ le rôle est pris___

Je crois que le tout numérique devrait commencer par l’émetteur ( le musicien) numérique… et , ça va de soi des spectateurs écouteurs du même métal.

Une sorte d’androïde robot …

Je pense pouvoir affirmer que le Nandroïd serait satisfait.

J’imagine un futur où un public Androïde passerait des heures de délices musicaux au spectacle d’Oscilloscopes

au delà des piques que j’envoie, bien sûr pour provoquer le débat, l’article est vraiment bien 🙂 . Faudra que je complète avec l’orgue un jour.

Lapa : qu’est-ce qu’un accordéon ? Sinon un instrument dont on joue exactement comme un accordéon et qui a le(s) son(s) d’un accordéon ?

Concernant cet instrument il faut signaler que « l’imitation » du son est particulièrement réussie, vraiment bluffante ; c’est en effet, (encore plus que la flûte, qui a quand même un grand choix d’attaques) un instrument assez simple, pauvre du point de vue de sa complexité sonore. Ce n’est évidemment pas le cas pour d’autres instruments pour lesquels une modélisation aboutie est encore hors de portée pour l’instant et, d’ailleurs, à mon avis, sans intérêt. (Je pense au violon, par exemple). Même le piano, ce n’est pas encore ça. J’ajoute qu’à partir du moment où, pour les besoins de la scène, tu es obligé de l’amplifier , l’intérêt sonore de l’instrument purement acoustique diminue énormément.

Certes, le haut-parleur est le boulet de la chaîne de reproduction sonore et il est étonnant que l’on n’ait encore rien inventé pour le remplacer (en tous cas, je n’en ai pas entendu parler), mais, « à haut-parleur constant » le numérique a quand même beaucoup apporté, à mon avis. Je l’ai déjà dit, je crois, mais je me souviens des premiers enregistrements numériques dans les années 80. Je travaillais alors à l’époque chez Star’s music one à Pigalle et tous les vendeurs y avaient été des musiciens professionnels habitués des studios et un débat était apparu sur les performances comparées de l’analogique et du numérique. La majorité trouvait le numérique « froid ». Moi je trouvais que c’était beaucoup plus fin et précis et je n’ai pas changé d’avis (évidemment je parle de fréquences d’échantillonnage conséquentes).

Non, un accordéon c’est un instrument de musique qui suit les règle de la facture instrumentale de l’accordéon. Un haut parleur donnant le son de l’accordéon n’est pas un accordéon, tout comme l’image d’un objet à la télé n’est pas l’objet quand bien même il serait filmé 24/24 et qu’on puisse être connecté à cette représentation via une « réalité virtuelle », qu’on puisse avoir des fonctions plus évoluées comme le ralenti, l’effet miroir, la loupe ou toutes autres choses que n’apporte pas la vision directe de l’objet réel. le fait même d’enrober la reproduction sonore amplifiée via membrane d’ une structure qui reproduit l’interface (et non l’instrument) avec le musicien peut évidemment nous faire croire que l’ensemble forme un instrument de musique; ce qui est trop peu à mon goût. Un instrument de musique ne se contente pas de sortir un son (auquel cas je l’ai déjà dit, un DJ serait musicien ou une chaîne Hi-FI un instrument), un instrument de musique nécessite un mécanisme de production sonore qui lui est propre, et un répertoire spécifique. or le mécanisme de production sonore de tous ces machins numériques est rigoureusement le même: le haut parleur. Donc à la rigueur, vu qu’on peut mettre à la place un son d’accordéon, de tuyau d’orgue, de grosse caisse ou de viole à roue on peut regrouper ça dans la même famille. A la rigueur. donc ce ne sont pas des accordéons ou des pianos ou des orgues. (ces instruments ne sont pas dans la même classification, leurs imitations numériques, si). ce sont des instruments dans la famille des imitateurs numérique à haut parleur. une fois ceci acquis, reste le répertoire. Il n’existe aucun répertoire écrit pour ces machins virtuels. Et c’est normal vu qu’ils ne font que reproduire des sons préexistants. L’orgue Hammond et le synthétiseurs sont à part, puisque ayant un répertoire propre et ne se contentant pas d’imiter. mais le répertoire de ton truc numérique c’est quoi? bah le répertoire de l’accordéon. Aucun artiste ne créera une œuvre pour truc numérique. Il créera une œuvre pour l’instrument original. le truc numérique reproduira (plus ou moins bien, et plutôt moins que bien) les sons de l’instrument d’origine. Donc notre machine numérique, c’est une interface qui ressemble à celle d’un instrument de musique, avec un son amplifié qui reproduit l’enregistrement (je souligne le mot) d’un instrument de musique. mais ce n’est en aucun cas un… Lire la suite »

Non, pas d’accord avec toi sur de nombreux points. D’abord le haut parleur n’est que l’étage final de la production du son, mais il n’est en est qu’un élément, et certainement pas le plus déterminant. A ce compte-là tous les instruments acoustiques ont aussi un mécanisme identique, c’est d’ailleurs ce que j’ai voulu montrer avec mes schémas : un truc qui vibre, une liaison mécanique avec un résonateur-amplificateur physique et un système pour mettre en vibration. Lorsque tu parles d’un « mécanisme de production sonore qui lui est propre », la chose la plus importante est le « mécanisme » mis en route par le musicien. Sur un accordéon, ce qui lui est spécifique c’est le soufflet, pas les anches libres car à ce compte-là un harmonica est un accordéon. Ce qui différencie le plus un violon d’un échantillonneur qui a un son de violon, c’est bien le frottement de l’archet sur les cordes. A partir du moment où un soufflet d’accordéon numérique réagit sur la production du son, comme un soufflet d’accordéon acoustique, tu as un accordéon. Pour caractériser l’instrument cela compte beaucoup plus que le son produit qui peut être plus ou moins proche de l’instrument imité. Et les accordéons eux-m^mes ont tout un tas de sons différents. Pourquoi le son d’un accordéon numérique ne pourrait-il pas s’ajouter aux sons de tous les accordéons existants ? Si la guitare électrique continue de s’appeler « guitare », c’est pour la même raison, alors que le son n’a pas grand chose à voir. C’est aussi ce qui fait la différence avec un DJ… Cela répond aussi à ton objection sur le répertoire : il est beaucoup plus déterminé par les possibilités liées à l’interface mécanique humain que par le son lui-même ( tessiture associée au nombre de touches d’un piano, choix des cordes à vide, de leur nombre, variation des enveloppes- sons courts sons longs, percussifs ou pas rapidité des redoublements etc) ces éléments là sont beaucoup plus déterminants que le son produit, la preuve d’ailleurs, ce sont toutes les transcriptions existantes pour différents instruments d’une même oeuvre. A la fois le fait qu’elles existent et le fait qu’elles nécessitent une transcription ! Je ne suis pas tout à fait convaincu non plus par l’idée que l’écoute de musique enregistrée, donc via des haut-parleurs, soit en elle-même un facteur d’appauvrissement de notre perception auditive. Je ne dis pas que c’est neutre, j’ai moi-même eu un expérience… Lire la suite »

Enfin, il est fréquent qu’une technologie en remplace une autre sans qu’elle apporte un mieux dans tous les domaines. Il suffit qu’elle soit plus performante dans certains domaines-clés, stratégiques. Pour les instruments de musique cela peut être l’encombrement, le prix (!!!!) la puissance, la justesse, la commodité du jeu…. des qualités qui sont en-dehors du son lui-même. Toute l’histoire de la facture instrumentale est pleine de cadavres exquis !

ceci est tout à fait exact. mais on revient à ces violes à 12 cordes (inaccordables) et autres joyeusetés non normalisées. Parfois, l’optimisation conduit à l’uniformité 🙂